线性回归

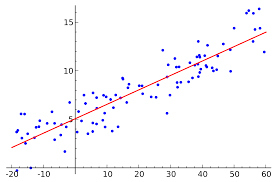

线性回归是一种用来模拟观测变量之间关系的技术。简单线性回归背后的想法是将两个变量的观察值“拟合”成它们之间的线性关系。图形化的任务是画出与点“最拟合”或“最接近”的线 在哪里 和 是两个变量的观测值,这两个变量之间是线性相关的。

变量之间最合适的线性关系

和

.[1]

变量之间最合适的线性关系

和

.[1]

在现实世界中统计的许多应用中,回归是一个常见的过程。有两种主要的应用类型:

预测:通过对变量的一系列观察,回归分析给出了变量之间关系的统计模型。这个模型可以用来产生预测:给定两个变量 和 该模型可以预测的值 鉴于未来的观察结果 这个想法被用于预测无数情况下的变量,如政治选举的结果,股票市场的行为,或职业运动员的表现。

相关:回归分析给出的模型通常会比其他模型更适合某些类型的数据。这可以用来分析变量之间的相关性,并完善统计模型,以纳入进一步的输入:如果模型很好地描述了数据点的某些子集,但对其他数据点的预测能力很差,那么检查不同类型数据点之间的差异以寻求可能的解释是有指导意义的。这种类型的应用在科学试验中很常见,例如,在对照研究中,一种拟议药物对病人的影响。

虽然许多最佳拟合方法是可能的,但对于大多数应用来说,最佳拟合线是用最小二乘.也就是说,看 的线性函数 该方法求线性函数 使近似误差平方和最小的是什么 通过

最小二乘法

最小二乘直线的一般公式

为什么最小二乘?

在寻找最佳拟合直线时,选择要最小化的数量决不是唯一的。误差的和,或误差的绝对值的和,通常看起来更自然。为什么最小二乘是标准?

原因之一是,求解最佳拟合直线所涉及的方程很简单,如上图所示。涉及绝对值函数的方程比多项式方程更难处理。另一个定性的原因是,它通常倾向于惩罚一个单一的大错误,而不是许多“中等”错误。但这并不能解释为什么指数 更倾向于,比如说, 或

最小二乘的最令人信服的证明是下面的结果高斯:

假设 我们测量值 和计算错误 如果这些误差(如测量误差)是独立的和正态分布,然后考虑,对于任何可能的线性函数 的概率 得到测量值 如果 是正确的模式。最小二乘线是 是最大化。

也就是说,在关于抽样误差的自然假设下,最小二乘线给出的模型最有可能是正确的。

使用线性代数的一般回归

下面的定理推广了最小二乘过程,并展示了如何使用最小二乘方法来寻找最佳拟合直线矩阵代数:

假设 是一个 矩阵, 假设 是一个 列向量。的 向量 ,最大限度地减少 = 只要 有排名

这是线性代数的一个标准定理。这个想法是分裂 作为一个向量的和 在的列空间中 和一个向量 垂直于的列空间 哪个是零空间中的向量 然后 是可以解决的, 是 到的列空间 所以它是使距离最小化的向量 根据需要。现在 结果如下。

前面的例子可以用矩阵语言改写:我们求方程的最小二乘近似 这个方程没有解(因为没有一条直线经过所有的5个点),但是最小二乘解是通过两边乘以得到的 和解决 哪个方程组是我们通过求偏导数得到的,并再次得到唯一解 和

参考文献

- Sewaqu。线性回归.2010年11月5日,从https://en.wikipedia.org/wiki/Least_squares#/media/File:Linear_regression.svg